摄像头+雷达+V2X三合一 无人驾驶触手可及

历经数十年的发展,自动驾驶技术经历了从摄像头检测可见光部分到摄像头+(激光/毫米波)雷达的二维平面到空间距离的跨越。随着自动驾驶技术的成熟度不断提升以及物联网时代的到来,在摄像头+雷达方案的基础上通过加入V2X即车联网的概念,使得汽车与汽车之间的数据可以相互传输,让汽车不仅能通过摄像头雷达感知到人类可视范围的行车环境,更是实现对人眼不可见不可听范围的扩大,同时大大降低由人为因素引发的车祸事故率,最终实现无人驾驶。

摄像头技术的积淀与加强

摄像头在汽车上根据功能可分为环视摄像头及前视摄像头,环视摄像头通常情况下由前后左右4个鱼眼镜头以及1个用来检测行人、车辆等状态的前视摄像头构成,4个环视摄像头直接做图像拼接。一般情况下环视系统中的ISP有分立和集成两种情况,其主要取决于图像处理器处理能力,正常情况下720P的环视系统采用的是集成的ISP,1080P的环视系统采用的是四个分立的ISP,因为离摄像头位置更近所以数据处理速度更快。

与环视相比,同样是摄像头技术的前视就相对难一些,它主要做一些行人检测以及车辆检测,因为需要各种检测算法比如光流算法、机器学习算法、机器视觉算法等。同时对于摄像头技术来说,要完成行车环境下车辆与行人都处于动态情况下的检测,就必须要求图像刷新频率足够高,图像处理能力足够强。

大约在2000年,摄像头技术主要集中在图像的一些特征提取,而现在大家主要在做一些深度学习的算法,其中最主要的就是神经元网络。其输入与我们常规理解的输入不同,比如说提取某一点的各个方向上的统一特性以及边缘特征,然后将这些特性作为输入去训练神经网络。在这一过程当中,整个行业以及学术界的难点均在于如何准确识别行人。

激光雷达精度保障与低价策略

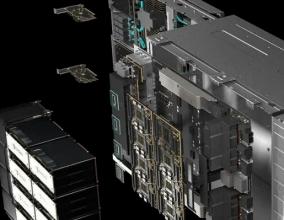

激光雷达是谷歌无人驾驶的核心所在,为此不仅捧红 Velodyne 公司更是在激光雷达的路上一去不复返。然而激光雷达成本过高,从数千美元到数十万美元不等,例如谷歌无人车目前使用的激光传感器:64 束激光,360 度扫描,单个定制的成本在 8 万美元左右。

在FTF2016峰会上恩智浦无人驾驶方案所采用的激光雷达传感器:8束激光,360度扫描,成本5000美元。众所周知激光束的多少直接影响垂直扫描角度以及数据点规模大小,因此激光雷达的价格也随着激光束的增多而出现大幅增加。

也正是由于激光雷达难以企及的价格,许多无人驾驶厂商试图通过其他更低廉的方式来达到相同的效果,比如恩智浦便通过8束激光雷达+4个毫米波雷达的方式。而特斯拉CEO Elon Musk也曾表示激光是一项矫枉过正的技术,让汽车完全自动化并不一定要用到激光雷达。所以特斯拉采用摄像头+12个远距离超声波传感器的方案,而这些摄像头传感器同样可以提供360度视角,且前置雷达系统可以帮助实现与测距相关的功能比如防碰撞、自动泊车等。

车辆互通 无人驾驶更进一步

在无人驾驶汽车中,雷达用来测距,摄像头用来观察周围物体。但由于每种技术都有其缺陷,所以将所有技术所采集到的数据用来做数据融合,假设视觉可靠率为90%,雷达可靠率为90%,然后再通过优化从而确定目标是人还是物(优化过程更多的是一些策略上的考虑),如此便可提高无人驾驶安全性能。

但是因为任何一个传感器数据传输回来都有数据不可靠的成分,因此当多方技术出现识别结果不一致时,要达到无人驾驶就需要将所有结果都检测一遍,达到100% 的准确率才能着手做无人驾驶。

也正因为所有传感器都不完全可靠,有误判的情况发生,所以通过给车辆加装一个V2X的模块并利用专用信道实现车与车,车与物之间的信息交流。如果以后所有交通参与者都有一个V2X的模块来互换信息,那么汽车便能感知到周围所有交通信息,从而实现真正的无人驾驶。

当然如果视觉技术、雷达技术与V2X判别出的结果不一致的情况,汽车便会自动采取放弃该结果重新判别,由于处理时间要求很高以及应用越来越复杂,因此对处理器的性能要求也越来越高。

在满足以上要求后,无人驾驶安全性能达到100%便不再是期望,而目前的情况是虽然已有平台在做自动驾驶,但路还很长,而自动驾驶以后发展的方向主要还是算法优化程度的提高以及处理器性能的提高两个方面。(责编:振鹏)

本文为华强电子网原创,版权所有,转载需注明出处

关注电子行业精彩资讯,关注华强资讯官方微信,精华内容抢鲜读,还有机会获赠全年杂志

关注方法:添加好友→搜索“华强微电子”→关注

或微信“扫一扫”二维码

- •大联大诠鼎集团推出基于联咏科技和思特威产品的AOV摄像头方案2024-10-23

- •艾迈斯欧司朗推出突破性8通道915nm SMT脉冲激光器,开创激光雷达应用新时代2024-08-08

- •极氪携多款新车型亮相北京车展,艾迈斯欧司朗助力打造智能驾乘体验2024-05-27

- •汽车智能化浪潮来袭,艾迈斯欧司朗助力速腾聚创发布MX激光雷达2024-05-21

- •谷歌裁员规模或达千人2024-01-15

- •禾赛科技激光雷达单月交付量突破5万台!2024-01-04

- •剑指百万台产能!这家厂商打造最全激光雷达产品矩阵2023-04-18

- •剑指百万台产能!这家厂商打造最全激光雷达产品矩阵2023-04-14

- •研究机构:2022 年中国消费级监控摄像头市场销量达 4820 万台2023-02-09

- •重磅!商务部拟将激光雷达等技术列入禁止限制出口目录2023-01-31