李开复“口误”曝AI行业内幕 你的“脸”真的安全吗?

一时“口误”,往往会激起惊涛骇浪。

人脸识别,如今已经成了中国AI领域一个标志性的应用。正因为全国各地的城市安防、支付认证以及无人化服务体系建设,才催生了一大波人脸识别的相关落地案例,让这一“生来高贵”的硬科技成为了国民日常生活的必需。

但相应的,人脸识别的大规模普及,也一再引发了人们对于“脸”安全性的忧思。无论是从APP、终端抑或是安防设备等渠道主动输入或被动输入的人脸数据,究竟都流向了何方?如此众多的AI公司,真能保证不泄密?自己的“脸”,究竟还安全吗?如此疑问三连,确也都是摆在数据公司与消费者之间的现实冲突。在9月2日的论坛场景下,被李开复一时的“心直口快”全面引爆。

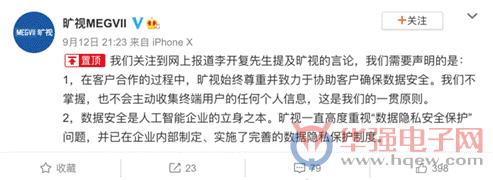

AI公司“多此一举”的公开澄清

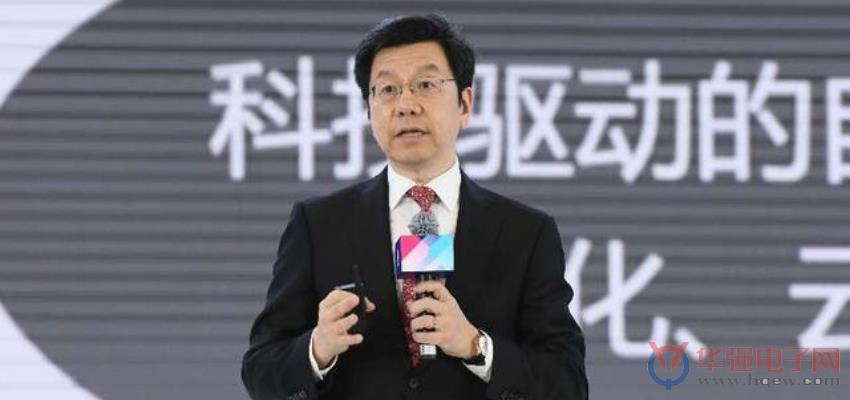

9月12日举办的首届HICOOL全球创业者峰会上,李开复于上午10:40进行演讲,称“旷视科技是我们在8年前投资的一个企业,今天是一个很快就有希望IPO的巨头了,它的发展路径很独特的,是一群技术人,没有任何产品和行业经验,靠着自己独特的技术能力来创业。我们早期帮助他们寻找了合作伙伴,包括美图、蚂蚁金服,让他们拿到了大量人脸数据,帮助他们分析各个行业怎么切入。”

“但早期还是犯了很多错误,走了很多弯路。在摸索过程中,找了几个有价值的商业化方向,包括安防、物流领域。”

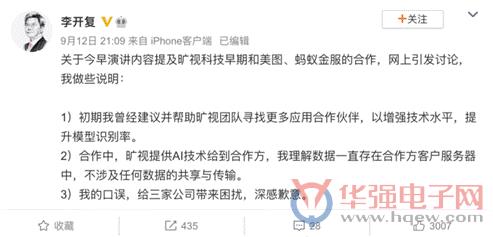

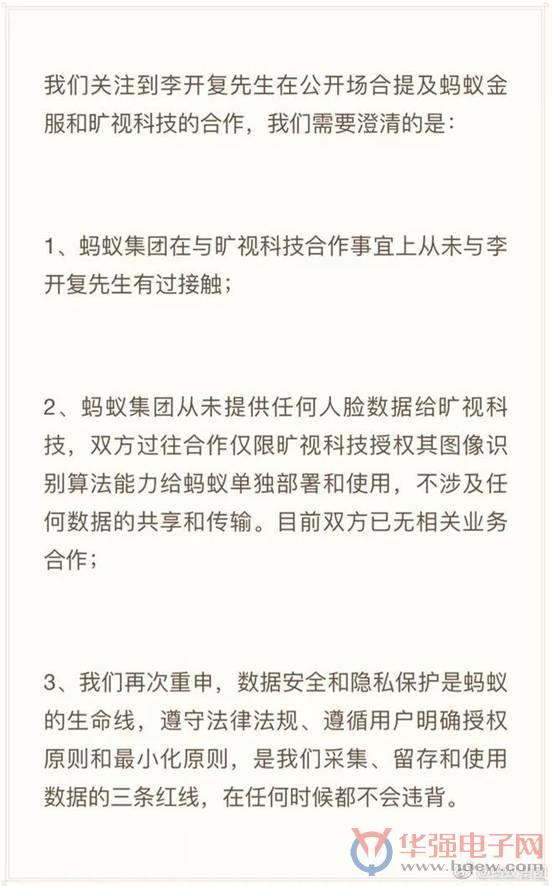

本来该言论并未惊起波澜,一片风平浪静,但当晚却被蚂蚁科技、旷视科技等关联公司的“一纸澄清”,彻底搅得天翻地覆。当晚,两家公司紧急否认,随后李开复也紧急发表声明称演讲时发生“口误”。尽管关联方均进行了紧急澄清,但此事的网络热度却持续发酵,逼近“不可控”的边缘。

毕竟,这也算是再次将“人脸安全”这一本不该被公开讨论的话题搬上台面。尤其是在中国,人脸识别为国民提供了巨大的便利,由此才得以让大众心甘情愿交出自己的“脸”来换取等价的服务。但实际上,用户对于人脸安全的忧思一直都在,从未被浇灭,只是深藏心底、静待爆发。

虽然事后,不少AI技术方案业内人士大都表示此类澄清从理论上来讲是没有错误的,但这仅限于行业里一些掌控大量绝对关键数据的大公司。人脸作为这类公司训练自主算法、提升产品核心竞争力的关键资源,定然不会慷慨解囊供他人所用,即数据公开分享不可能,顶多也只能通过高级合作或者投资才有机会在一定程度上接触到这些资源。

但对于屈居大公司之下的不少中小型人脸识别方案商而言,“规则”可能就不那么刻板了。甚至于有爆料称,部分企业为了获取资源或者谋取私利,公然通过互联网等相关渠道进行人脸数据的收售,用来丰富基础数据资源,提升算法服务能力,这也被称之为业内“潜规则”而长期存在。而且不那么为人所知的“地下黑市”,往往也存在着诸多人脸数据的买卖生意。也正是基于此类现象的屡禁不止,导致如今即便是大公司,用户时常也并不会给予充分的信任。

“人脸安全”问题何时休?

打从“人脸识别”出现的那一刻起,全球各国其实就已经开启了针对这一普适性技术的落地安全性讨论。时至今日,欧美各国虽然有不少人脸识别方面的优质项目,但鉴于种族矛盾以及对于隐私保护十分看重的基本国情要求,欧美地区对于人脸识别的应用一致抱着“禁”的态度。

在美国旧金山、奥克兰、波士顿等地积极颁布人脸识别禁令之后,其他美国地区也正陆续开始禁止采用人脸识别,即便是官方也不允许。比如9月9日,美国俄勒冈州波特兰市就通过了一项美国最严格的人脸识别禁令,不只是当地政府部门不能使用人脸识别技术,包括商店、饭店和旅馆在内等机构也被禁止使用该技术。

理由是,“人脸具有十分私密的属性,任何人的人脸都不应被随意地拍摄、存储和出售给第三方牟取利益。任何无辜者也不应该遭受司法系统不公平地对待,只是因为算法将他们错误识别成嫌疑人。”波特兰市议员乔·安·哈迪斯蒂(Jo Ann Hardesty)在该禁令通过的一周前,在其社交媒体上说。

相比之下,欧盟的政策相对宽限一些。比如今年1月,欧盟就在一份关于人工智能监管的白皮书中披露,正考虑颁布一项人脸识别技术禁令,可能在长达五年的时间里,禁止在公共场所使用人脸识别技术,以防止在更详细的规范出台之前,这项技术被滥用。

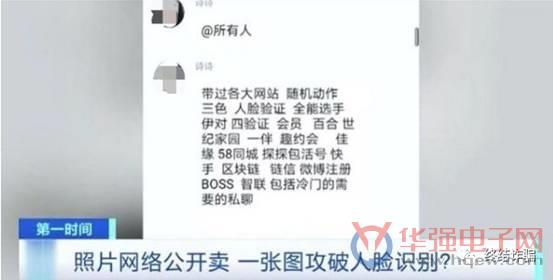

相比于欧美等国,中国市场显然是以更加开放的态度在拥抱新技术,因此对于人脸识别也是大力推广,但这其中也造就了很多负面案例。比如近期,国内警方就抓获了一个人脸识别认证黑产团伙,通过与银行内相关业务人员进行勾结,银行业务人员利用职务便利将客户的人脸(正脸,侧脸)资料留存下来,进行黑产售卖。黑产团伙利用一些辅助软件,按照自己的经验对照片进行调色,然后将调色后的照片导入到另一个软件,进行3D建模与渲染操作。一番勾选、渲染之后,照片就能够“活起来”,后续利用各类脚本的加持,达到骗过摄像头和认证系统的效果,整个过程操作起来十分流畅,俨然形成了一条流水线,而这类案件其实在当下的国内并不鲜见。

还记得2019年的世界黑帽安全大会上,腾讯的研究人员也向与会者展示了如何利用一款缠着黑白胶带的眼镜,就能解锁苹果FaceID的案例。不过,这项技术还需要“受害人”的被动配合——趁“受害人”睡着,将眼镜戴在“受害人”脸上,那么最新的AI技术,只需打印一张带有图案的纸条贴在脑门上,就能“戳瞎”AI识别系统。

对此,有业内人士表示:“目前大多数机器学习的鲁棒性都比较差,容易受对抗样本的影响。样本经过轻微修改后,输出结果可能会谬以千里,而且这些细微的修改人类几乎无法肉眼识别。”这也就是学术上被称为“对抗样本”的使用,一旦掌握了对抗样本(譬如纸条上的图案),只需在脑门上贴上纸条,就可以“戳瞎”系统,破解身份认证的唯一性。更不必提,如今美国大选,也时常因人脸识别技术而陷入混乱这一典型案例了。

总结:

人脸识别引发的一系列安全问题,的确让用户们无计可施。但显见的是,相比以往的指纹识别,安全系数无疑是得到极大程度的提升,也进一步提高了犯罪门槛。不过,道高一尺魔高一丈,即便是安全系数再高的技术,也都可能出现相应的破解方案,何况现阶段,人脸识别应用也只处于初级阶段,还有大量的问题和痛点需要被攻克与解决。但作为知名AI企业,在保障用户信息安全方面必须要有与之体量和名气相匹配的态度和责任感,私下交易固然是潜藏地下,难以为人所知,可一旦曝光出来,对于企业本身和整个应用生态而言都没有任何好处。

当然,从更积极的方向来看,现阶段如此众多的人脸识别安全性问题,也给相关企业创造了更多自我正名的机遇。毕竟,攻防是信息安全的本质,对于愈加复杂的信息网络,闭门造车,自扫门前雪的方式显然是不经济的,引导AI对抗技术的商业化落地,是加强网络安全的重要途径之一,也是促进AI技术应用和推广的安全保障。对于AI防御方而言——主要为AI研发、应用类企业,及评测、监管机构等,除自磨利刃外,可能更好的选择是与安全市场合作共赢,以提升系统鲁棒性,构筑AI防御护城河。

- •12万被召回!芯片安全隐患?两大新厂接力2022-04-08

- •三年巨亏240亿!“画饼王”商汤上市,AI行业彻底“癫狂”?2021-12-30

- •拆除“肇事”桅杆,深圳赛格广场大厦停运113天后重启 回迁商家:对大厦安全有信心2021-09-09

- •英飞凌推出安全微控制器,构筑全面的物联网生命周期管理解决方案2020-10-20

- •物联网系统可信任的“根”——揭秘英飞凌最新安全芯片解决方案2020-09-17

- •“自动+新能源”时代 汽车究竟需要怎样的“功能安全”?2020-08-04

- •UltraSoC和Canis Labs合作解决汽车行业信息安全漏洞2020-06-01

- •微信支付宝集体封杀三星,超声波指纹识别你还敢用吗?2019-11-06

- •中国首个5G安全行业标准达成2019-08-20

- •智能可视门铃发展火爆 对家庭安全来说是革命性进步2019-01-23