芯片三剑客 云端终端双场景各显神通

(3)云端芯片现状总结:GPU领先,FPGA随后,ASIC萌芽

AI芯片在云端基于大数据,核心负责“训练”。云端的特征就是“大数据+云计算”,用户依靠大数据可进行充分的数据分析和数据挖掘、提取各类数据特征,与人工智能算法充分结合进行云计算,从而衍生出服务器端各种AI+应用。AI芯片是负责加速人工智能各种复杂算法的硬件。由于相关计算量巨大,CPU架构被证明不能满足需要处理大量并行计算的人工智能算法,需要更适合并行计算的芯片,所以GPU、FPGA、TPU等各种芯片应运而生。AI芯片在云端可同时承担人工智能的“训练”和“推断”过程。

云端芯片现状:GPU占据云端人工智能主导市场,以TPU为代表的ASIC目前只运用在巨头的闭环生态,FPGA在数据中心业务中发展较快。

GPU应用开发周期短,成本相对低,技术体系成熟,目前全球各大公司云计算中心如谷歌、微软、亚马逊、阿里巴巴等主流公司均采用GPU进行AI计算。

谷歌除大量使用GPU外,努力发展自己的AI专属的ASIC芯片。今年5月推出的TPU与GPU相比耗电量降低60%,芯片面积下降40%,能更好的满足其庞大的AI算力要求,但由于目前人工智能算法迭代较快,目前TPU只供谷歌自身使用,后续随着TensorFlow的成熟,TPU也有外供可能,但通用性还有很长路要走。

百度等厂商目前在数据中心业务中也积极采用FPGA进行云端加速。FPGA可以看做从GPU到ASIC重点过渡方案。相对于GPU可深入到硬件级优化,相比ASIC在目前算法不断迭代演进情况下更具灵活性,且开发时间更短。AI领域专用架构芯片(ASIC)已经被证明可能具有更好的性能和功耗,有望成为未来人工智能硬件的主流方向。

(4)云端GPU:云端AI芯片主流,先发优势明显

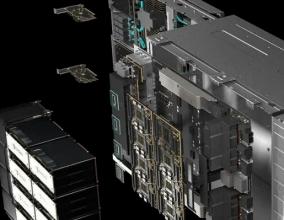

发展现状:GPU天然适合并行计算,是目前云端AI应用最广的芯片

GPU目前云端应用范围最广。目前大量涉足人工智能的企业都采用GPU进行加速。根据英伟达官方资料,与英伟达合作开发深度学习项目的公司2016年超过19000家,对比2014年数量1500 家。目前百度、Google、Facebook 和微软等IT巨头都采用英伟达的GPU对其人工智能项目进行加速,GPU目前在云端AI深度学习场景应用最为广泛, 由于其良好的编程环境带来的先发优势,预计未来仍将持续强势。

GPU芯片架构脱胎图像处理,并行计算能力强大。GPU(Graphics Processing Unit),又称视觉处理器,是之前应用在个人电脑、工作站、游戏机、移动设备(如平板电脑、智能手机等)等芯片内部,专门用作图像运算工作的微处理器。与CPU类似可以编程,但相比CPU更适合执行复杂的数学和几何计算,尤其是并行运算。内部具有高并行结构(highly paralle lstructure),在处理图形数据和复杂算法方面拥有比CPU更高的效率。

GPU较CPU结构差异明显,更适合并行计算。对比GPU和CPU在结构上的差异,CPU大部分面积为控制器和寄存器,GPU拥有更多的ALU(Arithmetic Logic Unit,逻辑运算单元)用于数据处理,而非数据高速缓存和流控制,这样的结构适合对密集型数据进行并行处理。CPU执行计算任务时,一个时刻只处理一个数据,不存在真正意义上的并行,而GPU具有多个处理器核,同一时刻可并行处理多个数据。

与CPU相比,GPU在AI领域的性能具备绝对优势。深度学习在神经网络训练中,需要很高的内在并行度、大量的浮点计算能力以及矩阵运算,而GPU可以提供这些能力,并且在相同的精度下,相对传统CPU的方式,拥有更快的处理速度、更少的服务器投入和更低的功耗。在2017年5月11日的加州圣何塞GPU技术大会上,NVIDIA就已经发布了Tesla V100。这个目前性能最强的GPU运算架构Volta采用台积电12nm FFN制程并整合210亿颗电晶体,在处理深度学习的性能上等同于250颗CPU。

(责编:振鹏)

本文为华强电子网原创,版权所有,转载需注明出处

关注电子行业精彩资讯,关注华强资讯官方微信,精华内容抢鲜读,还有机会获赠全年杂志

关注方法:添加好友→搜索“华强微电子”→关注

或微信“扫一扫”二维码

- •全球TOP10 MLCC厂商业绩大PK2026-06-03

- •元器件终端市场洞察及机会分析|2026052026-05-27

- •电子元器件销售行情分析与预判 | 2026年4月2026-05-12

- •元器件终端市场洞察及机会分析|2026042026-04-30

- •中国TOP16电子元器件分销商年度业绩大PK2026-04-29

- •电子元器件销售行情分析与预判 | 2026Q12026-04-23

- •汽车Tier1头部厂商年度业绩大PK2026-04-15

- •“2026半导体产业发展趋势大会”成功举办!2026-04-13

- •全球TOP4 AI服务器ODM年度业绩大PK2026-04-03

- •元器件终端市场洞察及机会分析|2026032026-03-27