美国最新芯片管制对国内供应链的影响

AI的发展离不开大算力、强算法、大数据三大要素。其中,大算力相当于人工智能的土壤,没有大算力的支持,就不会有AI的成功。

美国的“如意算盘”:卡住AI芯片的“脖子”

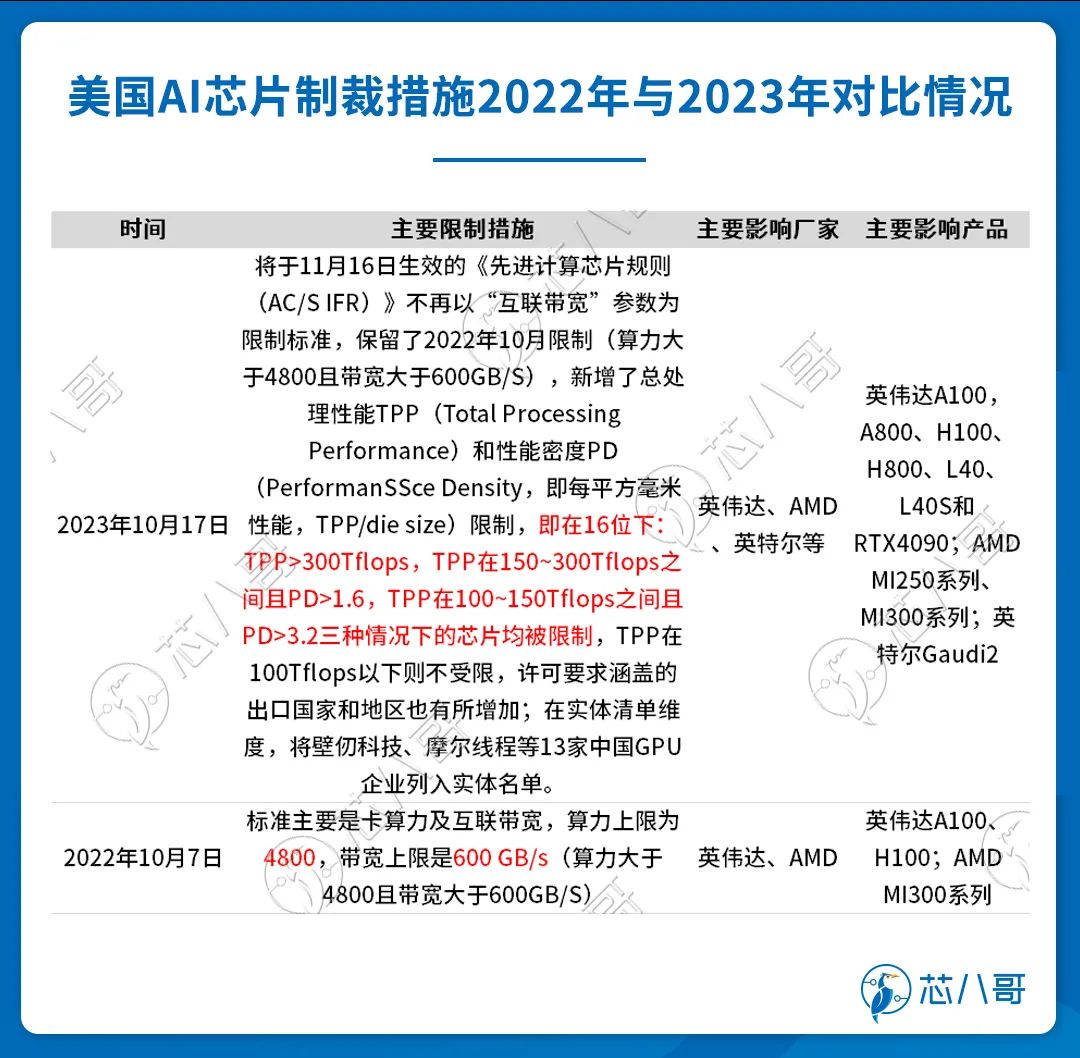

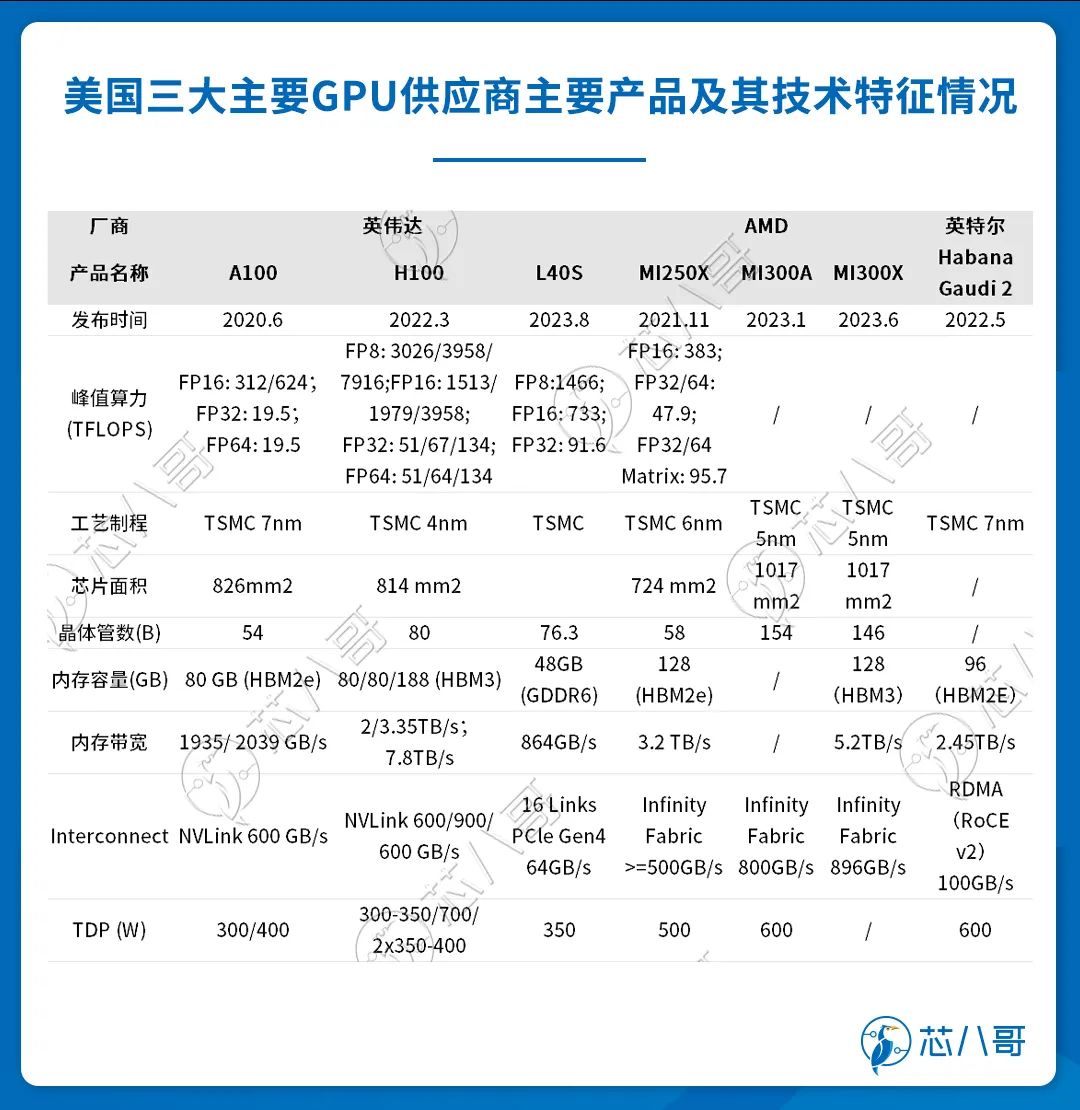

为了限制中国人工智能等高科技产业的发展,早在2022年10月7日,美国政府就规定算力上限为4800(INT8 超过 600TOPS 或 FP16 超过 300TFLOPS)以及带宽上限超过600 GB/s的AI芯片禁止向中国出口。这两条红线直接导致英伟达的A100、H100以及AMD的MI300系列成为管制对象。

资料来源:芯八哥整理

上有政策,下有对策。作为以盈利为目的而运营的商业化公司,英伟达在遵守美国政府规定的同时,针对中国市场特意推出了A800和H800芯片。其中,英伟达A800主要替代的是A100芯片,在数据传输速率上为每秒400GB,低于A100的每秒600GB。在内存带宽上最高达2TB/s,除了性能有所下降外,其他参数变化不大;而H800的具体参数尚未公开,但是带宽仅为H100(900 GB/s)的一半,执行相同的AI任务时H800可能比H100多花费10%至30%的时间。

自2022年11月OpenAI推出ChatGPT以来,全球生成式AI迎来了迅速发展。而在国内市场,随着百度文心一言的发布,众多大模型玩家如雨后春笋一样涌现,这带动了对英伟达AI训练/推理芯片需求的急剧增长。据供应链消息,在今年7月左右,英伟达特供国内的A800和H800芯片已经从原来的12万人民币,涨至了25万左右,甚至有的高达50万一片。尽管价格高涨,但英伟达的AI芯片仍然一片难求,据了解英伟达A800交货给大陆客户的交期已经要排到2024年第1季度。

显然,中国AI领域的快速发展让此前的禁令基本上形同虚设。意识到此前禁令规则的巨大漏洞后,时隔一年,美国针对中国AI芯片再次发起新禁令。

根据美国BIS在10月17日的新规显示,对AI芯片的具体限制条款从之前的性能算力和带宽限制,已经升级到了最新的算力密度和性能限制(即在16位下:TPP>300Tflops,TPP在150~300Tflops之间且PD>1.6,TPP在100~150Tflops之间且PD>3.2三种情况下的芯片均被限制,TPP在100Tflops以下则不受限),这将直接导致英伟达A800和H800芯片停止在中国市场销售,并且L40s、L40、RTX 4090等产品也会受到一定的影响。此外,AMD MI250系列、MI300系列以及英特尔人工智能芯片Gaudi2也有可能受到更新规则的影响,而且相关公司通过使用“Chiplet”技术来绕过对全芯片的限制的方式也违背了禁令规则。

美国最新出口管制对国内终端产业的影响

毫无疑问,先进AI芯片的进口受阻在短期内将会中国AI行业的发展造成一定的阻碍,并且会给相关企业的商业发展造成一定的影响。但好消息是,此次禁令主要针对的是高性能的数据中心/服务器的训练及推理领域,而对智能手机、PC、游戏等消费行业的影响相对较小。

影响1:AI大模型领域

ChatGPT的发布让AI迎来其“iPhone时刻”。据了解,OpenAI推出ChatGPT仅2个月,其月活用户就已经破亿,成为史上用户增长速度最快的消费级应用程序。在2023年3月15日,OpenAI正式推出GPT-4,凭借多模态的文本、图像输入及输出能力,直接引爆了整个科技圈。

此后,大模型市场迎来了真正的百花齐放。国外OpenAI、谷歌、微软等大厂正打得火热;国内百度、阿里、华为、腾讯等科技巨头,科大讯飞、智谱AI、商汤科技等AI公司,以及智源研究院、中科院等为代表的学术/研究机构都纷纷投身AI大模型的浪潮中。

AI大模型市场迎来了真正的百花齐放

资料来源:网络

截止目前,从全球已经发布的大模型分布来看,中美两国数量合计占全球总数的80%,而美国在大模型数量方面居全球之首。有专家披露,据不完全统计,目前中国 10 亿参数规模以上的大模型已发布 79 个。

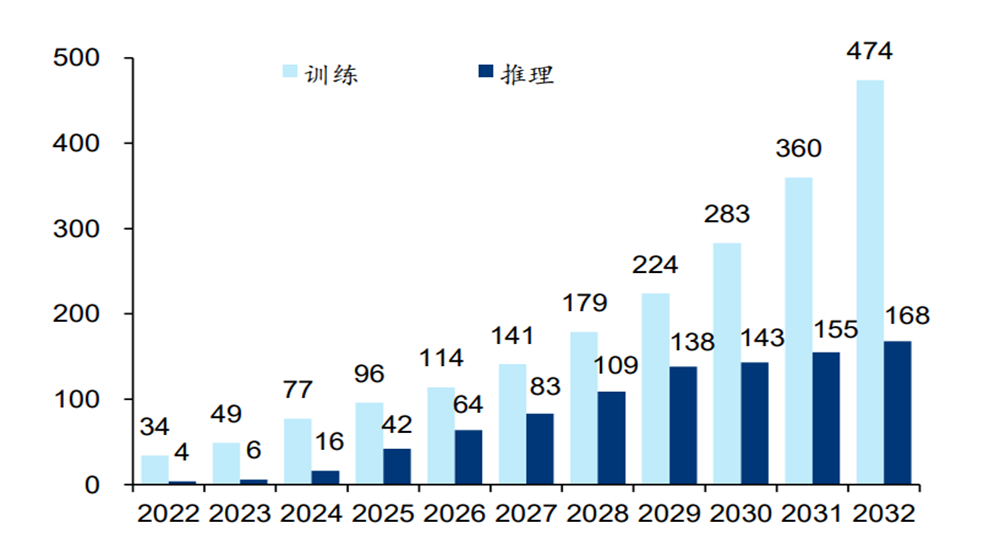

鉴于目前生成式 AI 主要以大参数模型路径实行,随着模型数量和所需要处理的数据量增长,其训练与推理均需要大量的计算能力与存储资源,故生成式 AI 大模型应用的蓬勃发展将带动高算力 AI 芯片的需求增长。根据IDC的数据显示,到2024 年,AI 训练和推理硬件市场规模将达 930 亿美元,而到 2032 年将逾 6000 亿美元。

AI 训练和推理硬件市场规模(单位:十亿美元)

资料来源:IDC

大模型的发展需要先进大算力的支撑,此次美国对AI芯片出口规定的实施,将对国内大模型未来的迭代及升级造成一定的的负面影响,会导致国内大模型的发展落后于国外玩家。不过,需指出的是,在禁令实施前包括腾讯、百度、阿里巴巴、字节跳动等大厂已经提前进行了AI芯片的大量囤货,估计在一定程度上将会把影响时间推迟。

影响2:互联网/云计算领域

近年来,随着生成式AI的兴起,字节跳动、腾讯、阿里巴巴、百度等云大厂和互联网巨头争先抢滩AI大模型,对算力需求不断提升。

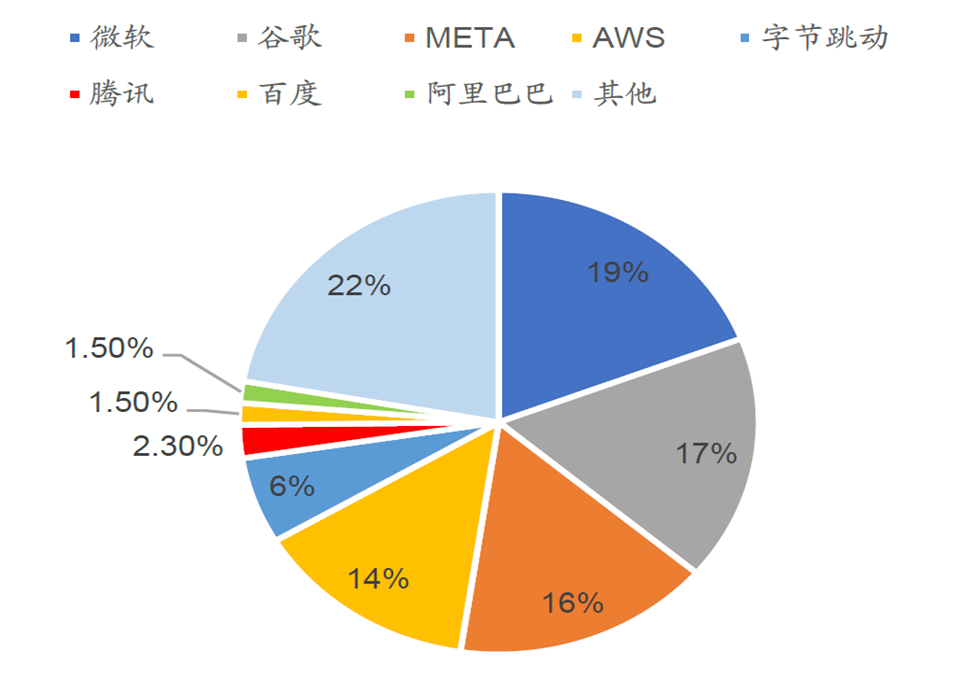

为了保证算力的供应,互联网/云大厂除了国内服务器厂商深度绑定外,也在持续加大对AI领域的投资支出。据Trendforce的数据,2022年全球企业AI服务器采购量中,字节跳动年采购占比达6.2%,腾讯、阿里巴巴、百度紧接其后,占比分别约为2.3%、1.5%与1.5%。各大龙头企业抓紧布局AI业务,引发AI服务器需求量激增,这直接带动了AI芯片需求的不断增长。

2022年全球各业者AI服务器采购量占比

资料来源:Trend Force

值得注意的是,AI服务器中价值量最高的是可用于AI训练和推理的GPU芯片,由于此前美国政府禁令的影响,英伟达停止向中国企业出售A100和H100(5纳米)两款GPU芯片,为此百度、字节跳动、腾讯和阿里巴巴等大厂合计向英伟达A800/H800下了总额达50亿美元的订单,以提前备货。此次A800(7纳米)和H800等芯片再次被限制,这些互联网厂商还需寻找更多的替代方案来保证自身业务的发展。

影响3:服务器领域

服务器作为高阶的计算机,存储、处理网络上超过80%的数据和信息,不仅是数字经济的重要基建,更是AI算力的核心组成,自然迎来了难得的发展机遇。

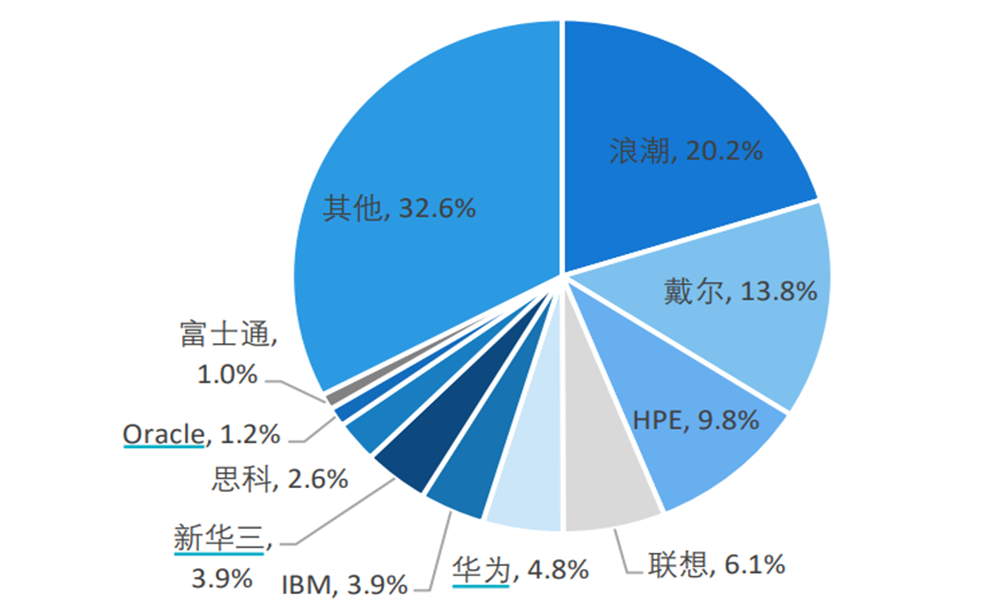

按应用的不同,AI服务器可分为训练和推理两种场景,按芯片类型可分为CPU+GPU、CPU+FPGA、CPU+ASIC等组合形式。目前,CPU+GPU是目前国内的主要选择,占比91.9%。市场份额方面,浪潮信息市场占有率达20.2%,戴尔、HPE、联想、华为占比分别为13.8%、9.8%、6.1%、4.8%。

2021年全球AI服务器市场份额

资料来源:Counterpoint,IDC

服务器行业虽然玩家众多,但从商业模式来看,整体可以分为两大类。一类是以戴尔、超微、惠普、浪潮、联想等为代表的品牌服务器(浪潮的JDM模式也包含于此),另外一类是以鸿海、英业达、广达、纬创、神达等为代表的白牌厂商。

从2022年美国对AI芯片出口禁令实施以来,国内包括以浪潮信息、联想等为代表的国内服务器厂商业务遭受重创。与之形成鲜明对比的是,以鸿海、英业达、广达等为代表的ODM厂商,是海外科技巨头加大云资本开支的最大受益者。因为这些ODM厂商多以中国台湾厂商为主,不受美国出口禁令的影响,并且能提供从服务器各种零部件到最终组装的一切服务,将在AI浪潮下迎来出货量及市场份额的进一步增长。

国产AI芯片供应链大变局

AI芯片是算力的基石。根据Gartner的数据,在大模型的催化作用下,预计到2023年AI芯片市场规模将同比增长20.9%,达到534亿美元。而随着下游应用场景的不断落地,据其预测到2027年AI芯片市场规模预计将达到1194亿美元。

1、市场需求及利益的刺激下,美国三大厂商正在积极寻求替代方案

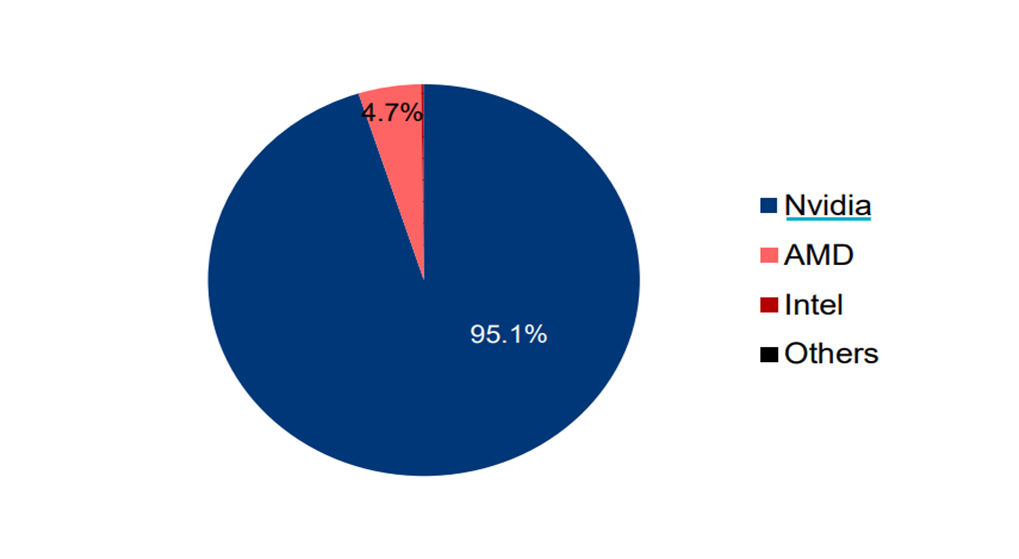

而从主要玩家来看,由于英伟达GPU产品线丰富、产品性能顶尖、开发生态成熟,目前全球AI算力芯片市场由英伟达的GPU垄断。根据IDC的数据,2022年英伟达占据了全球95.1%的GPU算力芯片市场份额。

2022 年服务器 GPU 单元份额情况

资料来源:IDC

作为GPU的典型代表,英伟达的A100、H100自生成式AI爆发以来一直严重供不用求,成为了各大科技公司争相采购的对象。而在中国市场上,互联网大厂也一直以英伟达的芯片作为首选,中国买家占据了其数据中心产品总收入的20%至25%左右。为了合规进入中国市场,英伟达此前推出了特供中国版的A800和H800,除了互连速度不同外,仍能实现核心的计算能力。此次出口管制再度升级,将导致英伟达的A800和H800产品没法供应,未来公司为保中国市场,可能会推出符合美国政府监管要求低配版的L40S等产品,以满足中国市场BAT等大客户的需求。

除了英伟达之外,在AI芯片领域,AMD近年来也取得了不错的发展成绩。在2023年Q2,客户对AMD AI 产品的“参与度”环比增长超过七倍,主要来自 MI300 的新订单和 MI250 的增量订购;而英特尔目前在 GPU 产品方面暂时掉队,但 ASIC 产品方面的 Gaudi 2目前也已在出货,而公司计划将在 2024 年推出 Gaudi 3,希望以CPU+ ASIC的方式作为加速器的配合主攻 AI 训练和推理。目前,AMD和英特尔的AI芯片产品都在本次出口管制范围内,不过在巨大的市场需求及利益的刺激下,未来这两家厂商预期也会推出类似此前英伟达H800 /A800的产品,以绕过美国政府相关规则的限制。

资料来源:芯八哥整理

2、中国企业迎来难得的国产替代发展机遇

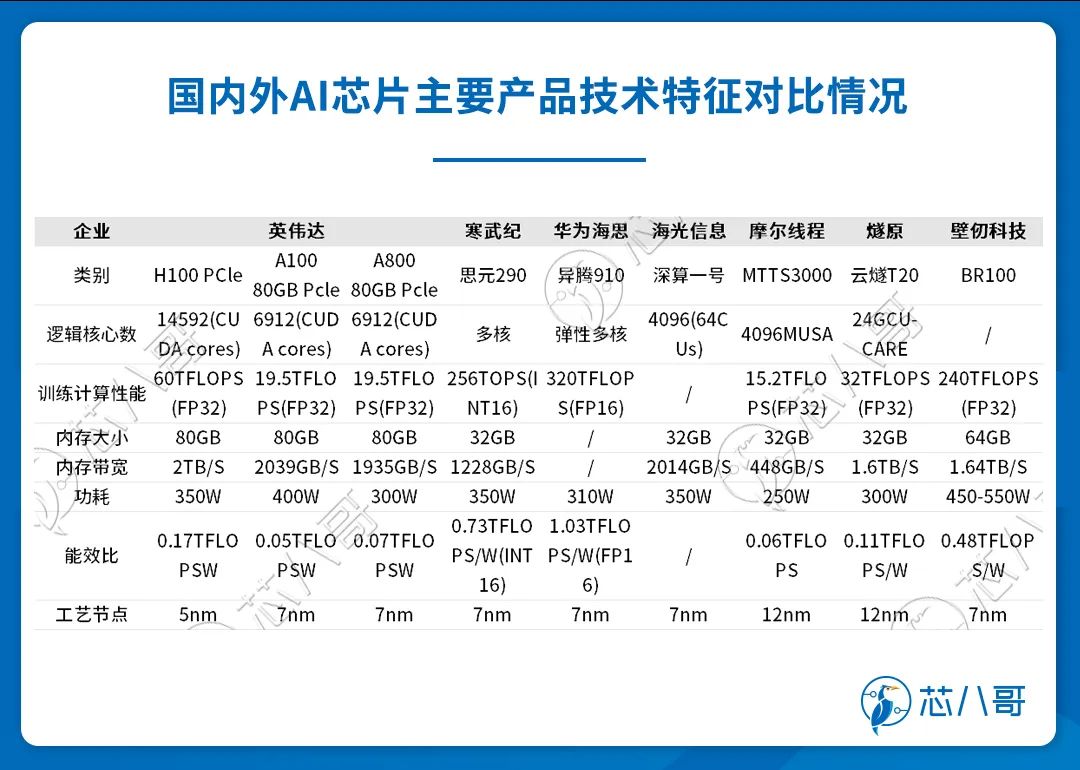

面对美国不断升级的出口管制政策,中国企业并没有选择坐以待毙。行业内包括华为、百度、阿里巴巴、腾讯等为代表的科技巨头,以寒武纪、海光信息、景嘉微等为代表的上市公司,以及以沐曦、天数智芯、壁仞科技、登临科技、摩尔线程等为代表的AI初创企业都在积极奋进,在实现自身快速发展的同时,也在力求突破美国技术封锁,努力实现国内AI芯片的自主可控。

资料来源:芯八哥整理

事实上,自2018年中美贸易摩擦以来,国内华为、阿里、百度、腾讯就已在自研AI芯片。其中,华为在AI领域推出的昇腾 910,采用7nm工艺,半精度(FP16) 算力达到 320 TFLOPS,整数精度(INT8)算力达到 640 TOPS,功耗 310W,据科大讯飞创始人、董事长刘庆峰透露,华为昇腾 910已经可以对标英伟达 A100,能够在国产平台上做训练及推理;百度孵化的昆仑芯推出训推一体AI芯片R200,采用7nm制程,INT8算力达256TOPS,目前该加速卡已经落地重庆市高级人民法院服务器、北京市实验室服务保障中心AI服务器等众多项目,累计订单已经超过千万级;背靠阿里的平头哥亦早在2019年就推出推理侧AI芯片含光800,采用12nm工艺,性能峰值算力达820 TOPS;而腾讯控股的燧原科技推出的i20、T21等训练推理产品,采用12nm工艺,通过架构升级大大提高了单位面积的晶体管效率,算力可媲美7nm GPU达到256TOPS,可满足数据中心等多种场景算力的需求。

上市公司方面,海光信息的DCU(Deep Computing Unit深度计算器,是GPGPU通用图形处理的一种)产品已具备强大的计算和高速并行数据处理能力,目前该系列产品已能够支持国产大模型,并且已成功和百度、阿里等互联网厂商以及浪潮、联想、新华三、同方等服务器厂商在合作;寒武纪推出的云端训练侧产品思元290达到512TOPS INT8算力,训推一体产品思元370达256TOPS INT8算力,而寒武纪的云端训练新品思元590芯片也在快速迭代中。目前,寒武纪的产品也已打入阿里云等头部互联网客户,并与头部银行等金融领域客户进行了深度的技术交流,同时亦得到了头部服务器厂商的认可。

而在初创企业方面,天数智芯的训练侧产品BI采用7nm工艺,算力可达295TOPS (INT8);沐曦首款异构 GPU 产品 MXN100 采用 7nm 制程,已于 2022 年 8 月回片点亮,主要应用于推理侧。此外,沐曦应用于AI 训练及通用计算的产品 MXC500 已于 2022 年 12 月交付 流片,公司计划 2024 年全面量产,可满足数据中心对高能效和高通用性的算力需求;壁仞科技在2022 年 8 月发布首款 GPGPU 芯片 BR100,该芯片采用 chiplet 技术,其 16 位浮点算力达到 1000T 以上、8 位定点算力达到 2000T 以上。

资料来源:芯八哥整理

值得一提的是,虽然近年来国内AI芯片发展较快,但与英伟达的A100/H100系列以及和AMD的 MI250/300系列等旗舰产品相比,在性能和生态上还有一定差距。以云邃T20产品为例,其32位单精度浮点性能达32TFLOPS,高于A100的19.5TFLOPS,且在功耗上更具优势,但内存宽带不足A100的1/3,在应对机器学习和深度学习的带宽需求上仍有差距;海光信息的深算一号产品指标基本达到国际上同类型高端产品的水平,部分参数可对标英伟达A100,但整体性能仅为英伟达的70%,差距也还是非常明显。

AI算力芯片设计难度较大,具有较高的技术壁垒。由于国内AI市场整体起步较晚,目前主要被英伟达等国外厂商垄断,国内市占比仅为10%左右。

美国接二连三的制裁,尽管对我国AI产业发展造成了一定阻碍,但同时也给国内AI芯片厂商带来了难得的国产替代发展机遇。相信在未来5-10年,随着国产替代的持续推进,我国AI算力市场的市场占比必将持续提高,而这一批具有先发优势的AI算力芯片厂商,也有望借此机会做大做强实现业务的快速发展。

*原创声明:本文系芯八哥原创文章,如需转载请通过关注芯八哥公众号并在后台私信申请开通白名单。以上授权仅针对公众号,转载请保持内容的完整性,并注明来源出处,所有内容不得删减、修改,不得做商业用途,不允许网站及第三方平台直接二次转载,未取得授权等非法转载,芯八哥将保留追究法律责任的权力。更多深度半导体行业观察和报告,请关注芯八哥微信号:icmyna。

- •关键节点落地! 美国芯片关税迈入“第二阶段”2026-04-15

- •中东局势升级:一场正在逼近的全球芯片供应链危机2026-03-24

- •突发!三星9万人准备罢工:全球芯片要变天了?2026-03-18

- •芯片价格全面失控:最高暴涨70%,这一轮半导体周期不一样了2026-03-18

- •2026最硬科技!原子级3D成像揭示芯片内部“鼠咬”缺陷,芯片研发从此不同2026-03-06

- •芯片战再升级!美政府采购禁令来袭,SIA强烈发声反对2026-03-05

- •阿里“造芯”走到关键一步?平头哥或冲击IPO2026-01-26

- •重磅消息!中国对日本进口芯片发起反倾销调查!2026-01-08

- •免费直播预告 | 从理论到实操,全面解析ADC/DAC芯片测试前沿方案!2025-06-17

- •摩尔斯微电子携手Gateworks,利用Wi-Fi HaLow革新工业连接2025-06-04